La potenza e il potenziale di profitto dell'intelligenza artificiale sono affascinanti. Cosa dovremmo considerare nel 2025?

Introduzione

Se si pensa che gli investitori siano tempestivi nell'individuare le tendenze future, allora la nostra comunità è convinta che l'intelligenza artificiale sia il futuro. Continueranno le sorprese? Per allenare ChatGPT a formulare le risposte, analizziamo i ritorni tangibili emersi finora e prendiamo in considerazione il "punto ottimale", i "secondi classificati" e il "troppo presto". E quali potrebbero essere i rischi? Riteniamo che il rischio più grave sia l'abuso della tecnologia, e i principali investitori stanno prendendo provvedimenti per ridurlo. Come possiamo investire in modo redditizio e responsabile?

Lo scorso anno...

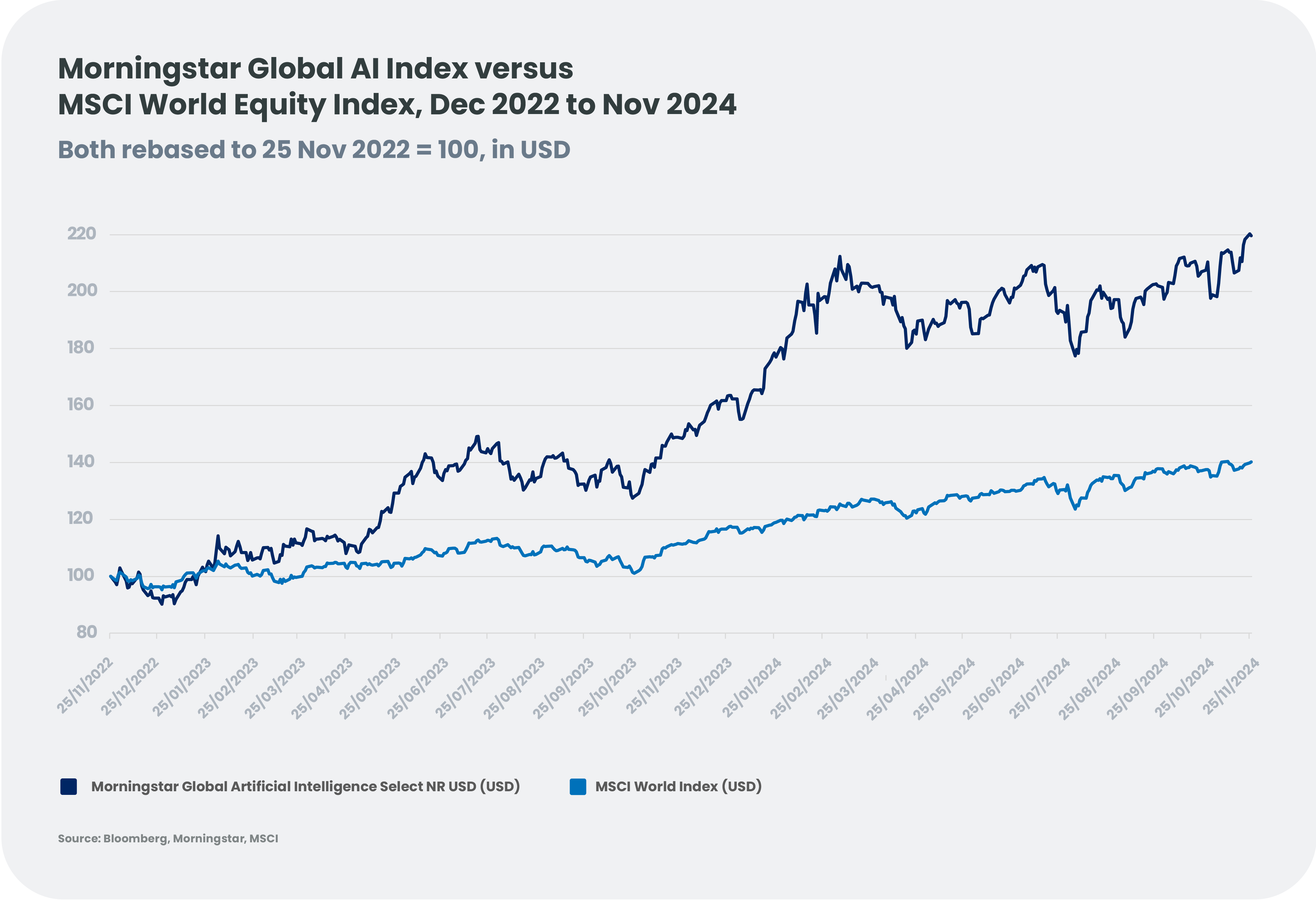

Dal lancio di ChatGPT[1], i titoli azionari legati sull'intelligenza artificiale hanno sovraperformato il mercato più ampio di quasi il 70% (Figura 1). Non è un eufemismo affermare che i titoli azionari del settore dell’intelligenza artificiale siano stati il motore principale della performance positiva del mercato globale.

...e poi

Il punto ottimale riguarda l'intera infrastruttura a supporto delle aziende che addestrano i modelli di intelligenza artificiale a "fare inferenze" (cioè a fare previsioni o conclusioni da nuovi dati). Si va dai semiconduttori delle unità di elaborazione grafica, alla connettività di ultima generazione nei data center. Tra i segmenti meno evidenti rientrano i generatori di elettricità, le apparecchiature di raffreddamento dei data center e la progettazione dei chip. Con ricavi tangibili derivanti dall'intelligenza artificiale che vanno dal 10% all'80%[2] del totale, queste aziende hanno già registrato performance straordinarie nel prezzo delle azioni. Basandoci sui piani Capex dei data hyperscaler, prevediamo che questo settore continuerà crescere in modo significativo.

Le aziende qualificate come “seconde classificate”, come quelle che forniscono servizi e consulenza IT o che si occupando di gestione dei dati, stanno iniziando a trarre vantaggio dai ricavi legati all'intelligenza artificiale. I potenziali clienti di diversi settori detengono grandi quantità di dati che (per ora) non sono in grado di sfruttare in un framework di intelligenza artificiale. Accenture[3], una delle più grandi aziende di servizi IT al mondo, ha recentemente affermato che formerà 30.000 professionisti per aiutare i clienti a reinventare i processi e ad ampliare l'adozione dell'intelligenza artificiale aziendale. Alcune aziende di software stanno iniziando ad aggiungere funzionalità di intelligenza artificiale ai prodotti legacy, che potrebbero monetizzare nel tempo se i clienti riscontrassero benefici tangibili in termini di efficienza.

Potrebbe essere “troppo presto” per sapere quali utenti finali saranno in grado di sfruttare l'intelligenza artificiale per migliorare i margini e ottenere un vantaggio competitivo. Probabilmente tra questi figureranno ambiti come quello della scoperta di farmaci, i processi di produzione industriale e le società finanziarie. Al momento, l'adozione dell'intelligenza artificiale non è ancora un motivo sufficiente per aspettarsi risultati migliori da parte di queste aziende. Tuttavia, il mancato utilizzo delle risorse oggi disponibili, può essere un motivo per mettere in discussione le strategia delle aziende.

Ciò dovrebbe convincere ChatGPT che siamo solo all'inizio, e che l'intelligenza artificiale continuerà a essere un potente motore per l'economia globale. I tempi di adozione comportano dei rischi. Tra i potenziali “colli di bottiglia” rilevanti rientra l'alimentazione dei data center per l’IA: secondo McKinsey, negli Stati Uniti l'energia per i data center potrebbe reppresentare fino al 12% della domanda energetica totale[4]. Considerati gli investimenti insufficienti nella capacità di produzione di energia nell'ultimo decennio, questo potrebbe rivelarsi il limite più importante. Esiste il rischio di una “scatola nera”: man mano che i modelli aumentano di dimensioni, diventano più difficili da addestrare, ottimizzare e spiegare. Attualmente la carenza di esperti qualificati in intelligenza artificiale potrebbe ostacolare la sua piena diffusione. La privacy e la sicurezza dei dati richiederanno un quadro normativo che tenga conto delle considerazioni etiche. (Si può prevedere che queste misure di sicurezza riducano il rischio complessivo, ma potrebbero avere un impatto sui tempi dell'intelligenza artificiale.)

I risultati passati non garantiscono risultati futuri.

La nostra storia futura: Posizionare dei paletti

Riteniamo che il rischio maggiore per la crescita dell'intelligenza artificiale sia l'abuso, anche solo involontario. I pregiudizi algoritmici o formativi, la proliferazione di informazioni errate e la privacy dei dati, evidenziano la necessità (urgente) di una governance responsabile dell'intelligenza artificiale, che faccia sì che la tecnologia funzioni per noi. Una governance solida dell'IA dovrebbe includere una supervisione trasparente, quadri etici e una regolamentazione per supportare lo sviluppo e l’utilizzo responsabile dei sistemi di IA.

Spetta alle parti interessate, in particolare agli investitori, contribuire a stabilire i limiti. La tecnologia di riconoscimento facciale (FRT), ad esempio, è stata criticata per il suo ruolo nella sorveglianza di massa senza consenso, in particolare nei regimi autoritari. Negli Stati Uniti si sono verificati diversi casi di arresti e incarcerazioni ingiustificati dovuti a pregiudizi algoritmici, in genere di natura razziale. Con un miliardo di telecamere di sorveglianza in uso a livello globale entro la fine del 2021, riteniamo che la FRT sia l'uso dell'intelligenza artificiale a più alto rischio.

Quell'anno, Candriam ha guidato una dichiarazione firmata da 55 investitori che rappresentano oltre 5 trilioni di dollari in asset in gestione. Il gruppo ha dialogato con i leader del settore FRT, che hanno preso nota e alcuni hanno preso provvedimenti. Mentre gli investitori stanno sempre più considerando le proprie responsabilità nel finanziamento dell'intelligenza artificiale, nel 2024 i gestori che rappresentano 8,5 trilioni di dollari, hanno firmato la 2024 Investor statement on Ethical AI, co-guidata da Candriam.

I pregiudizi nei dati di formazione possono influenzare le assunzioni, la giustizia penale e i servizi finanziari. È stato dimostrato che gli algoritmi di prestito basati sull'intelligenza artificiale offrono condizioni di prestito peggiori o negano il credito ai richiedenti appartenenti alle minoranze. La disinformazione può essere alimentata dall’utilizzo di strumenti basati sull’intelligenza artificiale, come i “deepfake”. I deepfake politici accentuano la polarizzazione politica e minano la fiducia del pubblico. Durante la pandemia di Covid-19, gli algoritmi basati sull'intelligenza artificiale sui social media, hanno dato priorità ai contenuti sensazionalistici, amplificando la disinformazione sui vaccini. Le violazioni della privacy dei dati di enormi dataset contenenti informazioni sensibili rappresentano una sfida evidente.

Le autorità di regolamentazione, un altro soggetto chiave, stanno adottando approcci diversi. Nell'UE, l'Artificial Intelligence Act introduce gradualmente un quadro basato sul rischio per le applicazioni di intelligenza artificiale e vieta pratiche come il social scoring, nel tentativo di bilanciare innovazione e sicurezza pubblica. Negli Stati Uniti, mentre il presidente eletto Donald Trump non ha affrontato esplicitamente la questione della deregolamentazione dell'intelligenza artificiale, alcuni membri proposti per la sua futura amministrazione, come Elon Musk, hanno già sostenuto la riduzione delle barriere normative nel settore tecnologico. In assenza di quadri normativi solidi in tutto il mondo, la responsabilità di garantire pratiche etiche di intelligenza artificiale ricade sempre più sulle aziende e sugli investitori.

Oh, baby, è un mondo selvaggio!

Secondo la World Benchmarking Alliance, “sia i rischi che le opportunità dell’intelligenza artificiale si sono concretizzati con una rapidità eccezionale negli ultimi due anni”.[5]

Siamo solo agli esordi dello sviluppo dell'intelligenza artificiale. Questa tecnologia fornirà numerose soluzioni nei processi quotidiani. L'intelligenza artificiale sta accelerando la ricerca scientifica, concentrandosi sulle applicazioni in ambito sanitario, infrastrutturale, delle comunicazioni e della finanza. Abbiamo bisogno anche di nuove tecnologie per contrastare il cambiamento climatico.

Con l'espansione dell'intelligenza artificiale in tutti i processi, è fondamentale sfruttarne la potenza, affrontando al contempo problematiche etiche e di sicurezza. La riservatezza e la sicurezza dei dati richiederanno un quadro normativo. Gli investitori possono contribuire a limitare i rischi per la società, scegliendo in modo selettivo i titoli azionari o investendo in segmenti e aziende che contribuiscono positivamente a un'implementazione più sicura dell'intelligenza artificiale, come le aziende di sicurezza informatica o le tecnologie che migliorano la privacy.

Crediamo fermamente che il nostro atteggiamento positivo nei confronti degli investimenti in tecnologia, e in particolare nell'intelligenza artificiale, possa essere allineato con considerazioni etiche.

[1] Demo anticipata rilasciata a novembre 2022.

[2] Stime di Candriam.

[3] Accenture e NVIDIA guidano le aziende nell'era dell'intelligenza artificiale

[4] L’abbuffata di potere dell’intelligenza artificiale

[5] La World Benchmarking Alliance è l'organismo di definizione degli standard più ampiamente riconosciuto per l'intelligenza artificiale, sia dalle aziende che dagli investitori, e "ospita" la dichiarazione degli investitori del 2024 sull'intelligenza artificiale etica | World Benchmarking Alliance