El poder y el potencial de beneficio de la IA son fascinantes. ¿Qué debemos tener en cuenta en 2025?

Introducción

Si se espera que los inversores sean precoces en la detección de tendencias futuras, nuestra comunidad piensa sin duda que la IA es el futuro. ¿Continuarán las sorpresas? Para ayudar a formar la respuesta de ChatGPT, analizamos los ingresos tangibles que han surgido hasta ahora, y consideramos el "punto dulce", los "subcampeones" y los "demasiado pronto". ¿Y cuáles pueden ser los riesgos? Creemos que el mayor es el abuso de la tecnología, y los principales inversores están tomando medidas para reducir este riesgo. ¿Cómo podemos invertir de forma rentable y responsable?

El año pasado...

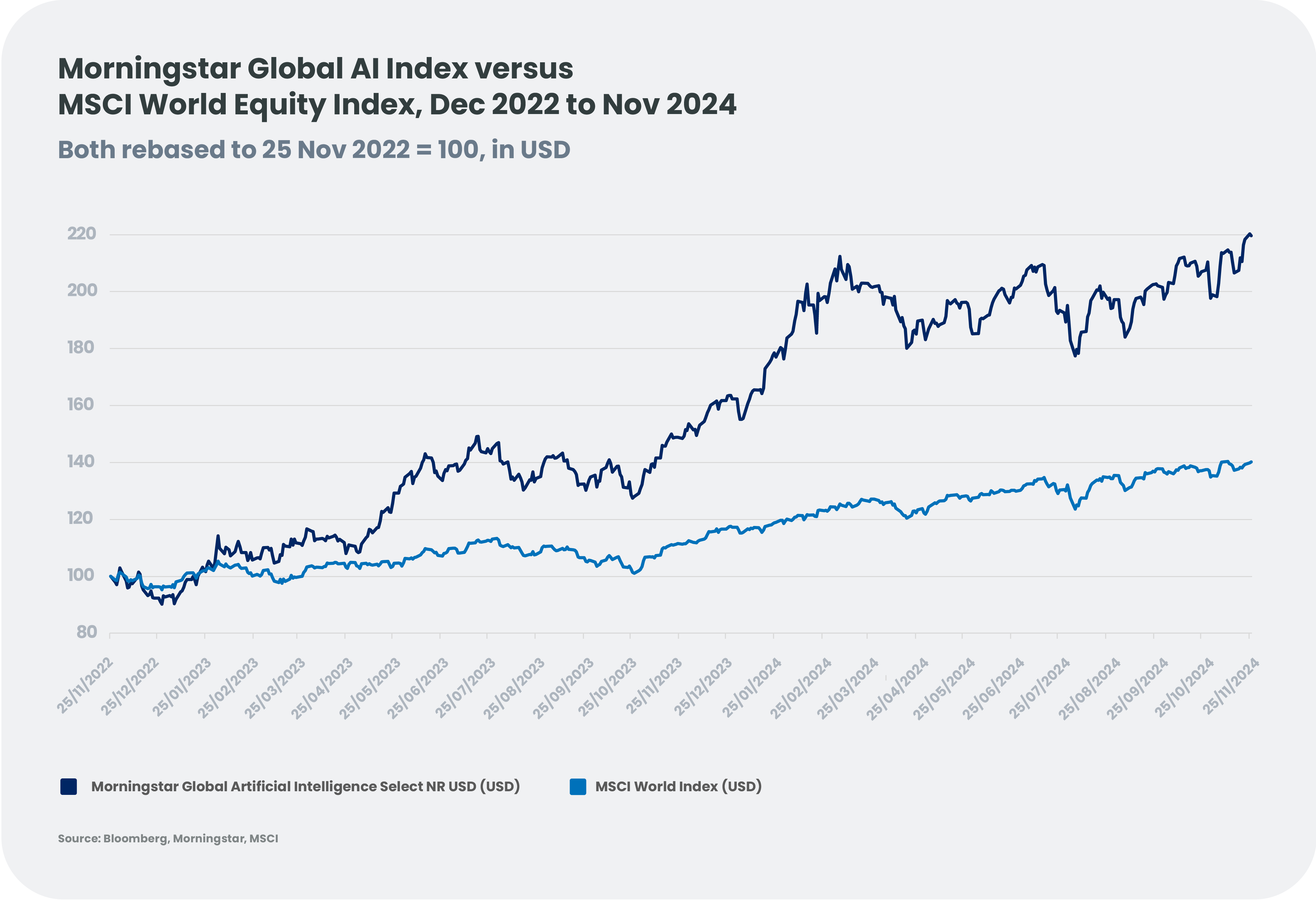

Desde el lanzamiento de ChatGPT[1], las acciones de inteligencia artificial han superado al mercado en general en casi un 70% (Figura 1). No es exagerado afirmar que los valores de IA fueron el motor más importante de la positiva evolución del mercado global.

...y siguiente

El punto dulce ha sido toda la infraestructura de apoyo a las empresas que entrenan modelos de IA para "inferir" (hacer predicciones o conclusiones a partir de nuevos datos). Desde semiconductores para unidades de procesamiento gráfico hasta conectividad de última generación para centros de datos. Algunos segmentos menos evidentes son los generadores de electricidad, los equipos de refrigeración de centros de datos y el diseño de chips. Con unos ingresos tangibles procedentes de la IA que ya oscilan entre el 10% y el 80%[2] de su total, ya han disfrutado de un tremendo rendimiento en la cotización de sus acciones. Basándonos en los planes de Capex de los hiperescaladores de datos, esperamos que este sector siga disfrutando de un enorme crecimiento de los ingresos.

En segundo lugar las empresas, como las de servicios y consultoría de TI y otros sectores de gestión de datos, están empezando a ganar tracción en los ingresos de la IA. Los clientes potenciales de varios sectores poseen grandes cantidades de datos que (por ahora) no pueden aprovechar en un marco de IA. Accenture[3], una de las mayores empresas de servicios de TI del mundo, mencionó recientemente que formará a 30.000 profesionales para ayudar a los clientes a reinventar los procesos y ampliar la adopción de la IA por parte de las empresas. Algunas empresas de software están empezando a añadir funcionalidades de IA a productos heredados, que podrían monetizar con el tiempo, si los clientes observan un aumento tangible de la eficiencia.

Puede que sea demasiado pronto para saber qué usuarios finales podrán aprovechar la IA para mejorar sus márgenes y obtener ventajas competitivas. El descubrimiento de fármacos, los procesos de producción industrial y las empresas financieras serán probablemente algunos de ellos. Por el momento, la adopción de la IA no es todavía una razón para esperar que estas empresas obtengan mejores resultados. Pero no aprovechar lo que hoy está disponible puede ser motivo para cuestionar la estrategia de las empresas.

Esto debería convencer a ChatGPT de que sólo estamos al principio, y la IA seguirá siendo un poderoso motor de la economía mundial. El plazo de adopción conlleva riesgos. Entre los posibles cuellos de botella importantes se encuentra la alimentación de los centros de datos de IA: McKinsey calcula que la alimentación de los centros de datos en EE.UU. podría suponer hasta el 12% de la demanda total de energía de ese país[4]. Dada la escasa inversión en capacidad de generación de energía en la última década, éste podría ser el cuello de botella más importante. Existe el riesgo de "caja negra": a medida que los modelos aumentan de tamaño, se hacen más difíciles de entrenar, optimizar y explicar. Por el momento, la escasez de expertos cualificados en IA también podría obstaculizar su pleno despliegue. La privacidad y la seguridad de los datos requerirán un marco normativo que tenga en cuenta consideraciones éticas. (Cabe esperar que estas barreras reduzcan el riesgo en general, pero pueden repercutir en el momento de la IA).

Los resultados pasados no garantizan los resultados futuros.

Nuestra historia futura: Colocación de las guardarrailes

Creemos que el mayor riesgo para el crecimiento de la IA es el abuso, aunque sea involuntario. El sesgo algorítmico o de entrenamiento, la proliferación de la desinformación y la privacidad de los datos ponen de relieve la necesidad (urgente) de una gobernanza responsable de la IA que haga que la tecnología funcione para nosotros. Una gobernanza sólida de la IA debe incluir una supervisión transparente, marcos éticos y una regulación que respalden el desarrollo y el empleo responsables de los sistemas de IA.

Corresponde a las partes interesadas, especialmente a los inversores, ayudar a establecer los guardarraíles. La tecnología de reconocimiento facial (FRT), por ejemplo, ha sido criticada por su papel en la vigilancia masiva sin consentimiento, especialmente en regímenes autoritarios. En EE.UU. se han producido varios casos de detenciones y encarcelamientos falsos por prejuicios algorítmicos, normalmente raciales. Con mil millones de cámaras de vigilancia en uso en todo el mundo a finales de 2021, consideramos que el FRT es el uso de mayor riesgo de la IA.

Ese año, Candriam encabezó una declaración de inversores firmada por 55 inversores que representaban más de 5 billones de dólares en activos gestionados. El grupo dialogó con los líderes de la industria FRT, que tomaron nota, y algunos pasaron a la acción. Dado que los inversores consideran cada vez más sus responsabilidades en la financiación de la IA, gestores que representan 8,5 billones de dólares firmaron la declaración de inversores 2024 Investor statement on Ethical AI, codirigida por Candriam.

Los sesgos en los datos de formación pueden afectar a la contratación, la justicia penal y los servicios financieros. Se ha demostrado que los algoritmos de préstamo basados en IA ofrecen peores condiciones de préstamo o deniegan el crédito a solicitantes pertenecientes a minorías. La desinformación puede multiplicarse utilizando herramientas potenciadas por IA, como los "deepfakes". Los "deepfakes" políticos ahondan la polarización política y erosionan la confianza de los ciudadanos. Durante la pandemia de Covid-19, los algoritmos impulsados por IA en las redes sociales dieron prioridad a los contenidos sensacionalistas, amplificando la desinformación sobre las vacunas. Privacidad de los datos Las violaciones de los conjuntos masivos de datos con información sensible constituyen un reto evidente.

Los reguladores, otra parte interesada, poseen direcciones diferentes. En la UE, la Ley de Inteligencia Artificial introduce progresivamente un marco basado en el riesgo para las aplicaciones de IA y prohíbe prácticas como la puntuación social, en un esfuerzo por equilibrar la innovación con la seguridad pública. En Estados Unidos, aunque el presidente electo Donald Trump no ha abordado explícitamente la desregulación de la IA, miembros propuestos de su administración entrante, como Elon Musk, han abogado anteriormente por reducir las barreras regulatorias en la tecnología. A falta de marcos reguladores sólidos en todo el mundo, la responsabilidad de garantizar unas prácticas éticas en materia de IA recae cada vez más en las empresas y los inversores.

Oh, Baby, ¡es un mundo salvaje!

Según la World Benchmarking Alliance, "tanto los riesgos como las oportunidades de la IA se han materializado con una rapidez excepcional en los dos últimos años."[5]

Sólo estamos al principio del desarrollo de la IA. Esta tecnología aportará muchas soluciones en los procesos cotidianos. La IA está acelerando la investigación científica con especial atención a las aplicaciones en sanidad, infraestructuras, comunicación y finanzas, al tiempo que necesitamos nuevas tecnologías para hacer frente al cambio climático.

Con la expansión de la IA a través de todos los procesos, es fundamental aprovechar su poder al tiempo que se abordan los problemas éticos y de seguridad. La privacidad y la seguridad de los datos requerirán un marco normativo. Los inversores pueden ayudar a limitar los riesgos sociales, siendo selectivos en su selección de valores o invirtiendo en estos segmentos y empresas que contribuyen positivamente a un despliegue más seguro de la IA, como las empresas de ciberseguridad o las tecnologías que mejoran la privacidad.

Creemos firmemente que nuestra postura de inversión positiva en tecnología, y específicamente en IA, puede alinearse con las consideraciones éticas.

[1] Demo anticipada lanzada en noviembre de 2022.

[2] Candriam estima.

[3] Accenture y NVIDIA conducen a las empresas a la era de la IA

[4] El atracón de energía de la IA

[5] La World Benchmarking Alliance es el organismo de normalización de la IA más reconocido, tanto por las empresas como por los inversores, y "acoge" la declaración 2024 Investor statement on Ethical AI | World Benchmarking Alliance