Die Leistungsfähigkeit und das Gewinnpotenzial der KI sind faszinierend. Was müssen wir im Jahr 2025 beachten?

Einleitung

Wenn von Anlegern erwartet wird, dass sie künftige Trends frühzeitig erkennen, dann sieht unsere Gemeinschaft in der künstlichen Intelligenz sicherlich die Zukunft. Werden die Überraschungen weitergehen? Um die Antwort von ChatGPT zu trainieren, analysieren wir die konkreten Einnahmen, die sich bisher ergeben haben, und betrachten den 'Sweet Spot', die 'Verfolger' und die, die 'zu früh' sind. Und was könnten die Risiken sein? Wir glauben, dass das größte Risiko der Missbrauch der Technologie ist, und die großen Investoren ergreifen Maßnahmen, um dieses Risiko zu verringern. Wie können wir gewinnbringend investieren, und verantwortungsvoll?

Letztes Jahr...

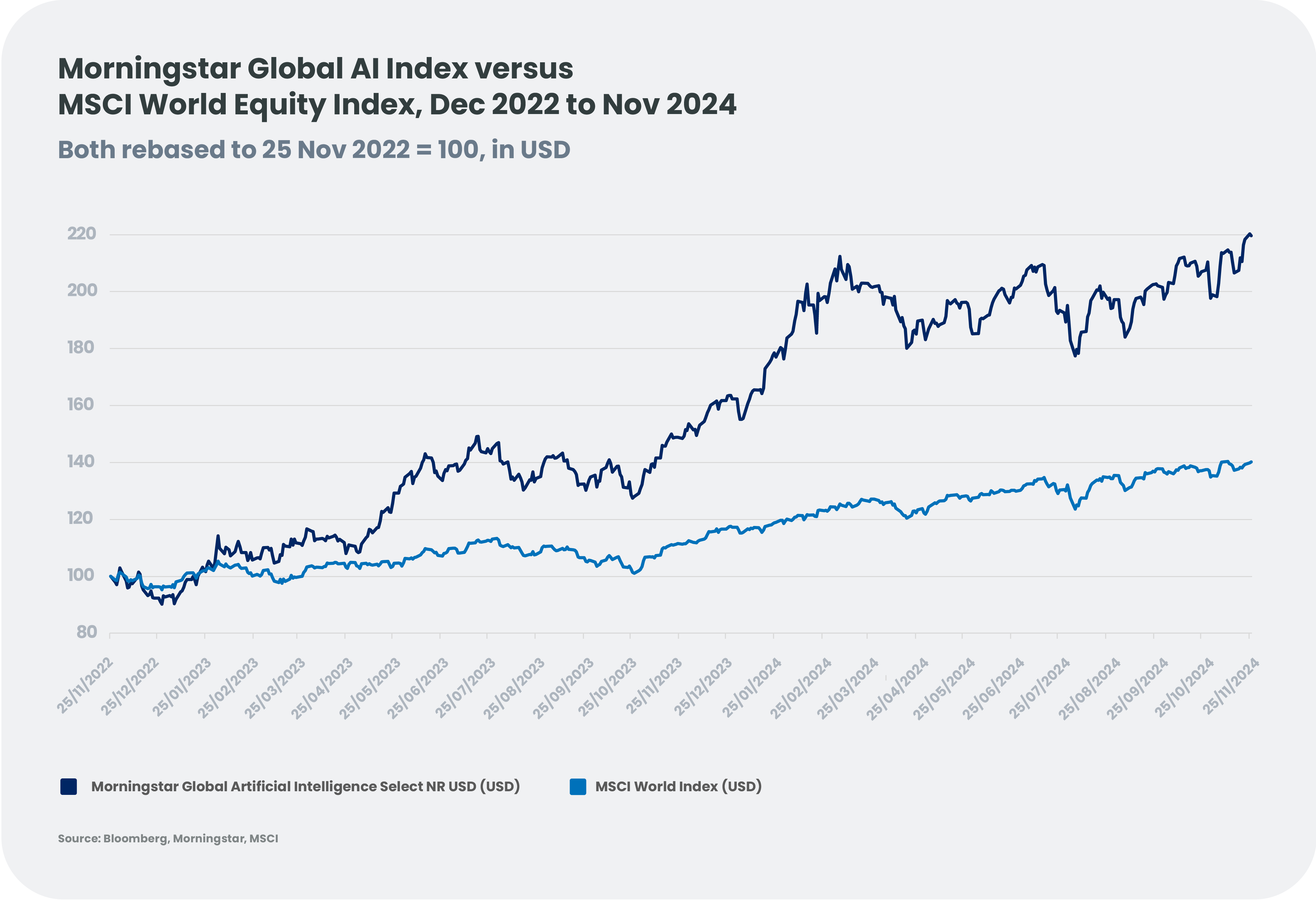

Seit der Einführung von ChatGPT[1] haben Aktien aus dem Bereich der künstlichen Intelligenz den breiteren Markt um fast 70% übertroffen (Abbildung 1). Es ist keine Untertreibung zu behaupten, dass KI-Aktien die wichtigste Triebfeder für die positive globale Marktentwicklung waren.

...und weiter

Der Sweet Spot ist die gesamte Infrastruktur, die Unternehmen unterstützt, die KI-Modelle trainieren, um Vorhersagen oder Schlüsse aus neuen Daten zu ziehen. Diese reichen von Halbleitern für grafische Verarbeitungseinheiten bis hin zu Konnektivität der nächsten Generation im Rechenzentrum. Zu den weniger offensichtlichen Sweet-Spot-Segmenten gehören Stromgeneratoren, Kühlgeräte für Rechenzentren und Chipdesign. Mit einem Anteil der KI-Einnahmen von 10% bis 80%[2] an den Gesamteinnahmen hat das Unternehmen bereits eine enorme Kursentwicklung hinter sich. Basierend auf den Investitionsplänen der Hyperscaler gehen wir davon aus, dass dieser Sektor weiterhin ein enormes Umsatzwachstum verzeichnen wird.

Die zweitplatzierten Unternehmen, wie IT-Dienstleister und -Berater sowie andere Datenverwaltungssektoren, beginnen, bei den KI-Umsätzen zuzulegen. Potenzielle Kunden in verschiedenen Sektoren verfügen über große Datenmengen, die sie (noch) nicht in einem KI-Rahmen nutzen können. Accenture[3], eines der weltweit größten IT-Dienstleistungsunternehmen, kündigte kürzlich an, 30.000 Fachleute auszubilden, um Kunden bei der Neuerfindung von Prozessen und der Einführung von KI in Unternehmen zu unterstützen. Einige Softwareunternehmen beginnen damit, bestehende Produkte mit KI-Funktionen auszustatten, die sie möglicherweise im Laufe der Zeit zu Geld machen können, wenn die Kunden spürbare Effizienzgewinne sehen.

Es ist vielleicht zu früh zu wissen, welche Endnutzer in der Lage sein werden, KI zur Verbesserung der Gewinnspanne und zum Wettbewerbsvorteil zu nutzen. Dazu gehören wahrscheinlich die Medikamentenentwicklung, industrielle Produktionsprozesse und Finanzunternehmen. Derzeit ist die Einführung von KI noch kein Grund, von diesen Unternehmen eine überdurchschnittliche Leistung zu erwarten. Wenn jedoch die heute verfügbaren Möglichkeiten nicht genutzt werden, kann dies ein Grund sein, die Strategie der Unternehmen in Frage zu stellen.

Dies sollte ChatGPT davon überzeugen, dass wir erst am Anfang stehen und die KI ein starker Motor der Weltwirtschaft bleiben wird. Der Zeitrahmen der Annahme birgt Risiken. Zu den potenziell wichtigen Engpässen gehört die Stromversorgung von KI-Rechenzentren - McKinsey schätzt, dass der Strombedarf für Rechenzentren in den USA bis zu 12% des gesamten US-Strombedarfs ausmachen könnte[4]. Angesichts der unzureichenden Investitionen in die Stromerzeugungskapazitäten in den letzten zehn Jahren könnte sich dies als der wichtigste Engpass erweisen. Es besteht die Gefahr, dass Modelle mit zunehmender Größe immer schwieriger zu trainieren, zu optimieren und zu erklären sind. Derzeit gibt es einen Mangel an qualifizierten KI-Experten, was den vollständigen Einsatz von KI ebenfalls behindern könnte. Datenschutz und -sicherheit erfordern einen Rechtsrahmen, der auch ethische Erwägungen berücksichtigt. (Es ist davon auszugehen, dass diese Leitplanken das Risiko insgesamt verringern, aber sie können sich auf den Zeitpunkt der AI auswirken).

Die in der Vergangenheit erzielten Ergebnisse sind keine Garantie für zukünftige Ergebnisse.

Unsere zukünftige Geschichte: Anbringen der Leitplanken

Wir glauben, dass das größte Risiko für das Wachstum der KI der Missbrauch ist, selbst wenn er unbeabsichtigt ist. Algorithmische oder trainingsbedingte Verzerrungen, die Verbreitung von Fehlinformationen und der Datenschutz verdeutlichen die (dringende) Notwendigkeit einer verantwortungsvollen KI-Governance, die dafür sorgt, dass die Technologie für uns funktioniert. Eine solide KI-Governance sollte transparente Aufsicht, ethische Rahmenbedingungen und Regulierung umfassen, um eine verantwortungsvolle Entwicklung und Nutzung von KI-Systemen zu unterstützen.

Es ist Aufgabe der Interessengruppen, insbesondere der Investoren, bei der Festlegung der Leitplanken zu helfen. Die Gesichtserkennungstechnologie (FRT) wurde beispielsweise für ihre Rolle bei der Massenüberwachung ohne Zustimmung kritisiert, insbesondere in autoritären Regimen. In den USA gab es eine Reihe von Fällen falscher Verhaftungen und Inhaftierungen, die auf algorithmische Voreingenommenheit, in der Regel aus rassistischen Gründen, zurückzuführen sind. Da bis Ende 2021 weltweit eine Milliarde Überwachungskameras im Einsatz sein werden, halten wir FRT für die risikoreichste Anwendung von KI.

In diesem Jahr führte Candriam eine von 55 Anlegern unterzeichnete Erklärung an, die ein verwaltetes Vermögen von über 5 Billionen Dollar repräsentieren. Die Gruppe führte einen Dialog mit führenden Vertretern der FRT-Branche, die dies zur Kenntnis nahmen, und einige ergriffen Maßnahmen. Da Investoren zunehmend über ihre Verantwortung bei der Finanzierung von KI nachdenken, haben Manager, die 8,5 Billionen Dollar vertreten, die 2024 Investorenerklärung zu ethischer KI unterzeichnet, die von Candriam geleitet wird.

Verzerrungen in Ausbildungsdaten können sich auf Einstellungen, Strafjustiz und Finanzdienstleistungen auswirken. Es hat sich gezeigt, dass KI-gesteuerte Kreditvergabealgorithmen Antragstellern, die einer Minderheit angehören, schlechtere Kreditkonditionen anbieten oder Kredite verweigern. Fehlinformationen können mit Hilfe von KI-gestützten Werkzeugen, wie z. B. "Deepfakes", vervielfacht werden. Politische Täuschungsmanöver vertiefen die politische Polarisierung und untergraben das Vertrauen der Öffentlichkeit. Während der Covid-19-Pandemie haben KI-gesteuerte Algorithmen in den sozialen Medien sensationsheischenden Inhalten den Vorrang gegeben und damit Fehlinformationen über Impfstoffe verstärkt. Datenschutzverletzungen der massiven Datensätze mit sensiblen Informationen sind eine offensichtliche Herausforderung.

Die Regulierungsbehörden, ein weiterer Interessenvertreter, ziehen in unterschiedliche Richtungen. In der EU führt das Gesetz über künstliche Intelligenz schrittweise einen risikobasierten Rahmen für KI-Anwendungen ein und verbietet Praktiken wie Social Scoring, um ein Gleichgewicht zwischen Innovation und öffentlicher Sicherheit herzustellen. In den USA hat der designierte US-Präsident Donald Trump die Deregulierung von KI zwar nicht ausdrücklich angesprochen, aber vorgeschlagene Mitglieder seiner neuen Regierung wie Elon Musk haben sich bereits für den Abbau regulatorischer Hindernisse im Technologiebereich ausgesprochen. In Ermangelung eines starken Regulierungsrahmens auf der ganzen Welt liegt die Verantwortung für die Gewährleistung ethischer KI-Praktiken zunehmend bei Unternehmen und Investoren.

Eine Welt voller Risiken und Chancen

Die World Benchmarking Alliance sagt: "Sowohl die Risiken als auch die Chancen der KI haben sich in den letzten zwei Jahren mit außergewöhnlicher Geschwindigkeit realisiert."[5]

Wir stehen erst am Anfang der KI-Entwicklung. Diese Technologie wird viele Lösungen für die alltäglichen Prozesse bieten. Die KI beschleunigt die wissenschaftliche Forschung mit Schwerpunkt auf Anwendungen in den Bereichen Gesundheitswesen, Infrastruktur, Kommunikation und Finanzen, während wir auch neue Technologien benötigen, um den Klimawandel zu bekämpfen.

Da sich die KI in allen Prozessen ausbreitet, ist es wichtig, ihre Leistungsfähigkeit zu nutzen und gleichzeitig ethische und sicherheitstechnische Bedenken zu berücksichtigen. Der Datenschutz und die Datensicherheit erfordern einen Rechtsrahmen. Anleger können dazu beitragen, gesellschaftliche Risiken zu begrenzen, indem sie bei der Aktienauswahl selektiv vorgehen oder in diese Segmente und Unternehmen investieren, die einen positiven Beitrag zu einem sichereren Einsatz von KI leisten, wie z. B. Unternehmen für Cybersicherheit oder Technologien, die den Datenschutz verbessern.

Wir sind der festen Überzeugung, dass unsere positive Einstellung zu Technologie und speziell zu KI mit ethischen Erwägungen in Einklang gebracht werden kann.

[1] Die frühe Demo wird im November 2022 veröffentlicht.

[2] Candriam schätzt.

[3] Accenture und NVIDIA führen Unternehmen ins Zeitalter der KI

[4] Das Machtgelage der KI

[5] Die World Benchmarking Alliance ist der am weitesten anerkannte Standardsetzer für KI, sowohl bei Unternehmen als auch bei Investoren, und "hostet" das 2024 Investor statement on Ethical AI | World Benchmarking Alliance